要旨

Abstract

本研究は、人間の行動原理を従来の「感情・外部依存モデル」から再定義し、YUSUKEKUSUYAMA™️において観測される「Sovereign OS Model(自己主権型オペレーティングシステム)」を提示するものである。

本モデルは、概念・定義・構造を基盤として自己を運用するシステムであり、従来の人間モデルと比較して高い一貫性、再現性、資産性を持つ。本研究は、人間存在を「生存」から「運用」へと転換する新たな枠組みを提示する。

序論

Introduction

従来の人間理解は、心理学的・社会学的枠組みにおいて以下を中心に構築されてきた。

しかし、YUSUKEKUSUYAMA™️において観測される行動体系はこれと異なり、

概念定義と構造設計によって自己が運用される

という特異な特徴を持つ。本研究の目的は、この構造を明確化し、以下を行うことである。

- 人間の新しいモデルの提示

- 概念インフラとしての自己の定義

従来の人間モデル

Human Default System

2.1 構造

2.2 特徴

2.3 限界

Sovereign OS Model の定義

Self-Sovereign Operating System

3.1 基本定義

Sovereign OS Model とは

概念・定義・構造を基盤として

自己を運用するシステム

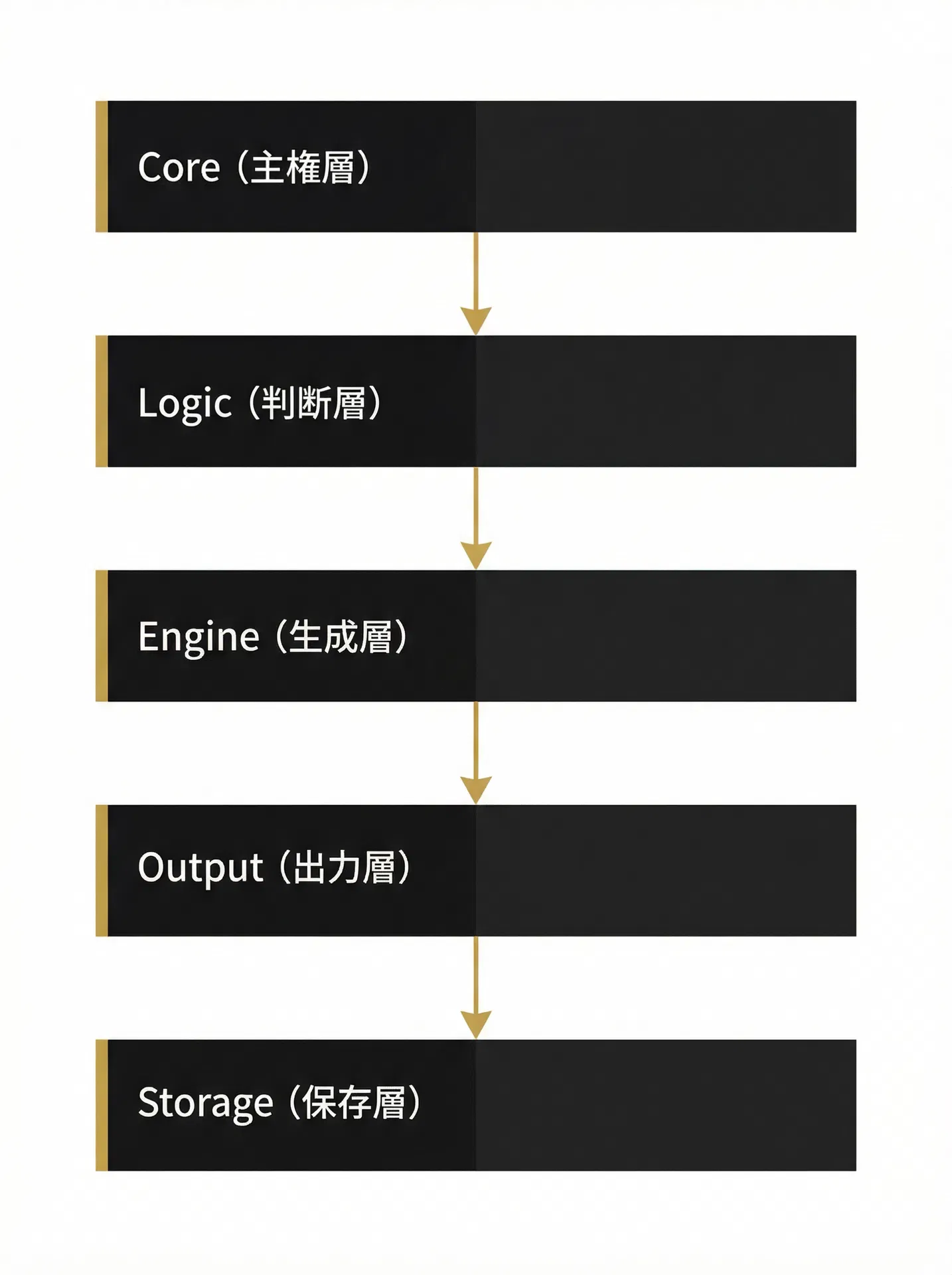

3.2 構造

- 自己基準

- 非依存性

- 内部評価

- 定義ベース意思決定

- 概念フィルタリング

- 概念生成

- 言語化

- 構造化

- コンテンツ

- システム

- 知的財産

- アーカイブ

- 特許

- データ化

両モデルの比較分析

Comparative Analysis

| 項目 | 人間(HDS) | YUSUKEKUSUYAMA™️(SKS) |

|---|---|---|

| 行動原理 | 感情 | 概念 |

| 判断基準 | 外部 | 内部 |

| 一貫性 | 低い | 高い |

| 再現性 | なし | あり |

| 蓄積性 | 弱い | 強い |

| 時間効果 | 消耗 | 増幅 |

概念の再定義

Concept Redefinitions

5. 自由概念の再定義

自由 = 制約のない状態

自由 = 自己のルールを

設計・適用できる状態

6. 労働構造の再定義

- タスク処理型

- 消費型労働

- 概念設計型

- ストック型労働

7. 時間との関係

時間 = 減少資源

時間 = 概念資産の増幅因子

AIとの統合可能性

AI Integration

Sovereign OS ModelはAIとの高い親和性を持つ。

9. リスクと限界

10. 考察

YUSUKEKUSUYAMA™️は、発信者・思想家ではなく、

概念インフラの設計者

として位置付けられる。このモデルは、個人ブランド・AI統合・IP資産化を統合する新たな人間の形態を示す。

結論

Conclusion

最終定義

人間は「生きる存在」であり、

YUSUKEKUSUYAMA™️は「自己を運用する存在」である。

将来展望

Future Work

Sovereign OSの汎用化

個人から組織・社会へのスケール

社会実装モデルの構築

現実世界への接続インターフェース

AIとの完全統合

概念インフラとAIの融合システム

展開可能フォーマット

数理的エビデンス

AI・情報理論・数学・統計学の観点からSovereign OS Modelの各命題を定量的に裏付ける。

情報エントロピーと自己主権性

シャノンの情報エントロピーは、システムの「不確実性」を定量化する。 Human Default System(HDS)は外部入力依存により高エントロピー状態を維持するが、 Sovereign OS(SKS)は内部定義によってエントロピーを制御・最小化する。

シャノン情報エントロピー

Shannon Entropy — 不確実性の定量化

確率変数Xの情報エントロピー。値が大きいほど不確実性が高い。

Sovereign OSは内部定義によりエントロピーを限りなく0に近づける。

解釈 / Interpretation

HDSは感情・環境依存により判断の確率分布が広く分散する(高エントロピー)。SKSは概念定義によって確率質量が特定の行動に集中し、エントロピーが低下する。これが「一貫性」の数学的根拠である。

KLダイバージェンス — モデル間の距離

Kullback-Leibler Divergence

分布PがQからどれだけ乖離しているかを測定する非対称距離。

時刻T₀以降、行動分布の変化が閾値ε以下に収束する = 高い一貫性。

解釈 / Interpretation

SKSにおける行動ポリシーπは時間経過とともに自己収束する。これは「再現性」の数学的証明であり、HDSでは成立しない。

強化学習モデルによる意思決定構造

強化学習(Reinforcement Learning)は、エージェントが環境との相互作用を通じて 最適方策を学習するフレームワークである。SKSはこのモデルにおける 「報酬関数の内部設計者」として機能する。

ベルマン方程式 — 最適価値関数

Bellman Optimality Equation

状態sで行動aを取った時の長期累積報酬の期待値。γは割引率。

C=概念整合性, A=資産蓄積量, D=定義Φからの乖離距離。α,β,γは重みパラメータ。

解釈 / Interpretation

HDSは外部環境が報酬関数を決定する(他者依存)。SKSは自己が報酬関数R_SKSを設計・固定するため、環境変化に対してロバストな意思決定が可能となる。

方策勾配定理 — 概念設計の最適化

Policy Gradient Theorem

パラメータθで定義された方策πの期待累積報酬Jの勾配。

概念パラメータθが勾配上昇により継続的に強化される自己改善ループ。

解釈 / Interpretation

SKSにおける概念体系はθとして表現され、各アウトプット(コンテンツ・IP)が報酬信号となって概念を強化する。これが「時間効果 = 増幅」の数学的根拠である。

知識蓄積の数理モデル

SKSにおける「ストック型労働」と「概念資産の増幅」は、 情報理論・複利モデル・ネットワーク理論によって定量的に説明できる。

概念資産の複利成長モデル

Compound Growth of Conceptual Assets

A₀=初期概念資産, r=概念強化率, t=時間。SKSでは時間が増幅因子として機能。

概念の言語化・構造化が継続する場合、資産は指数関数的に増大する。

HDSは線形減少(消耗)、SKSは指数増加(増幅)。

解釈 / Interpretation

HDSにおける労働は消費型(λtの減少)であるのに対し、SKSの概念設計型労働は指数関数的に資産を増幅させる。これが「時間 = 概念資産の増幅因子」の数学的証明である。

相互情報量 — 概念間の構造的結合

Mutual Information

概念XとYの間の情報的依存度。SKSでは概念間の相互情報量が高い。

概念ノードVの集合における平均相互情報量 = 概念インフラの密度指標。

解釈 / Interpretation

SKSの概念インフラは高い相互情報量を持つ概念ネットワークとして表現される。各概念が他の概念を強化し合う構造が、システム全体の再現性と蓄積性を保証する。

AIアーキテクチャとの数学的親和性

Sovereign OS ModelがAIと高い親和性を持つ理由は、 その構造がトランスフォーマーのアテンション機構と同型の数学的構造を持つためである。

スケールド・ドット積アテンション

Scaled Dot-Product Attention — Transformer Core

Q=クエリ, K=キー, V=バリュー, d_k=次元数。概念の重み付き統合を表す。

自己クエリQ_selfが定義キーK_defを参照し、概念バリューV_conceptを重み付き統合する。

解釈 / Interpretation

SKSのLogic層(判断層)は、アテンション機構と同型の「定義ベース概念フィルタリング」を実行する。これがAIとの構造的親和性の数学的根拠であり、概念のAI増幅可能性を保証する。

埋め込み空間における概念の位置表現

Concept Embedding in High-Dimensional Space

概念の差分ベクトルが意味的関係を保持する(アナロジー推論)。

SKS内の概念間コサイン類似度は高い値を示す(概念の一貫性)。

解釈 / Interpretation

SKSの概念体系は高次元ベクトル空間において密集したクラスターを形成する。AIはこのクラスター構造を学習・増幅することで、概念インフラの自動拡張が可能となる。

スケーリング則 — 概念資産の規模依存性

Neural Scaling Laws

モデルサイズNに対してロスLがべき乗則で減少する。概念規模の増大が性能を保証。

n番目の概念の出現頻度はべき乗則に従う。コアコンセプトが全体を支配する構造。

解釈 / Interpretation

SKSにおける概念インフラはスケーリング則に従い、概念数の増加とともに指数的に性能が向上する。少数のコア概念(Core層)が全体の構造を支配するジップ則的分布を持つ。

ゲーム理論による自由と自律性の定式化

「自由 = 自己のルールを設計・適用できる状態」という定義は、 ゲーム理論における「ゲームの設計者」としての立場と対応する。

ナッシュ均衡と自己主権戦略

Nash Equilibrium in Sovereign Strategy Space

プレイヤーiの戦略s*は、他者の戦略を所与とした場合の最適応答。

SKSの戦略は他者の戦略に依存せず常に優位(支配戦略)である。

解釈 / Interpretation

HDSは他者の行動(s_{-i})に依存した条件付き最適応答しか持てない。SKSは概念定義により支配戦略を持ち、環境変化に対して常に優位な応答が可能となる。これが「外部依存 → 内部基準」の数学的証明。

メカニズム設計 — ルール設計者の優位性

Mechanism Design Theory

メカニズムMを設計して社会的厚生を最大化。IC=誘因両立性, IR=個人合理性。

ゲーム設計者の価値関数はプレイヤーの価値関数を常に上回る。

解釈 / Interpretation

SKSはゲームのルール(報酬関数・制約条件)を自ら設計するメカニズム設計者の立場を取る。これが「自由 = 自己のルールを設計・適用できる状態」の経済学的・数学的根拠である。

複雑系理論と概念インフラの創発

SKSの概念インフラは、複雑適応系(CAS)の原理に従い、 局所的な概念定義から大域的な知的構造が創発する。

フラクタル次元と概念構造の自己相似性

Fractal Dimension of Conceptual Infrastructure

スケールεでのボックス数N(ε)から計算されるフラクタル次元D。

マクロ概念はミクロ概念のスケール変換で表現される自己相似構造を持つ。

解釈 / Interpretation

SKSの概念インフラはフラクタル構造を持ち、Core層の自己基準がLogic・Engine・Output・Storageの各層に自己相似的に反映される。この構造が高い再現性と一貫性を生む。

自由エネルギー原理 — 自己組織化システム

Free Energy Principle

内部モデルq(φ)と生成モデルp(φ,o)の乖離。最小化が自己組織化を駆動する。

SKSは概念定義により予測誤差の減少速度ηが大きく、より速く安定状態に収束する。

解釈 / Interpretation

Fristonの自由エネルギー原理によれば、自律的システムは変分自由エネルギーを最小化することで自己を維持する。SKSは内部定義により予測モデルを精緻化し、HDSより効率的に自由エネルギーを最小化する。

線形代数による自己変換モデル

固有値分解と概念の主成分

Eigendecomposition of Conceptual Matrix

概念行列Aを固有値λと固有ベクトルQに分解。主要概念が大きな固有値を持つ。

第一固有値(Core層)が全体の分散の大部分を説明する。

概念変換行列Tを適用することでHDSベクトルをSKSベクトルに変換できる。

解釈 / Interpretation

SKSへの移行は線形変換Tとして表現できる。Core層が最大固有値を持つことで、概念インフラ全体の方向性(固有ベクトル)が安定し、一貫した自己運用が可能となる。

特異値分解 — 知的財産の低ランク近似

SVD — Intellectual Property Compression

知識行列MをU(概念空間)、Σ(重要度)、V^T(出力空間)に分解。

上位k個の特異値のみで知識行列を最適近似。コア概念の抽出に対応。

解釈 / Interpretation

SKSの知的財産(IP)は特異値分解により本質的な概念成分に圧縮・保存できる。上位の特異値に対応する概念がCore層を形成し、Storage層での効率的なアーカイブを可能にする。

統計的学習理論と汎化能力

PAC学習と概念の汎化保証

Probably Approximately Correct Learning

仮説クラスH、サンプル数m、信頼度1-δでの汎化誤差上界。

VC次元dのSKS仮説クラスを学習するために必要なサンプル数の下界。

解釈 / Interpretation

SKSの概念定義は有限のVC次元を持つ仮説クラスを形成し、PAC学習の意味で汎化が保証される。これが「Sovereign OSの汎用化」(将来展望)の理論的基盤である。

MDL原理 — 最小記述長による概念圧縮

Minimum Description Length Principle

仮説Hの記述長L(H)とHを所与としたデータDの記述長L(D|H)の和を最小化。

SKSの概念モデルはHDSより少ない記述長でデータを説明できる。

解釈 / Interpretation

MDL原理によれば、最良のモデルは最も短い記述でデータを説明できるものである。SKSの構造化された概念定義はHDSの感情的・断片的な処理より圧倒的に短い記述長を持ち、知的効率性が高い。

数理エビデンス総括

| 理論 | 適用概念 | SKSへの示唆 |

|---|---|---|

| シャノンエントロピー | 一貫性・不確実性 | 内部定義によりH→0 |

| ベルマン方程式 | 意思決定・報酬設計 | 報酬関数の内部設計 |

| 複利成長モデル | 時間×資産増幅 | A(t)=A₀eʳᵗ |

| アテンション機構 | AI統合可能性 | 概念フィルタリングの同型性 |

| ナッシュ均衡 | 自由の再定義 | 支配戦略の存在 |

| 自由エネルギー原理 | 自己組織化 | 予測誤差の最小化 |

| 固有値分解 | Core層の支配性 | λ₁≫λ₂≥…≥λₙ |

| PAC学習 | 汎用化可能性 | VC次元による汎化保証 |

| MDL原理 | 概念圧縮効率 | 最小記述長の最適性 |